AI-Search Optimization vs. GEO & AEO: Warum wir keine neuen Akronyme für RAG-Systeme brauchen

Warum GEO und AEO oft nur leere Hüllen für Agentur-Pitches sind und warum "AI-Search Optimization" der präzisere Begriff für unsere tägliche Arbeit mit modernen Sucharchitekturen ist.

GEO und AEO klingen nach Innovation. Dahinter steckt RAG und das optimierst du mit denselben Hebeln wie beim klassischen SEO. Hier ist die technische Begründung.

Schluss mit dem Akronym-Bingo

Wir haben das doch alle schon erlebt. Voice Search kam, und plötzlich verkauften Agenturen VSO. Dann Visual Search. Jetzt, mit dem Aufstieg von LLMs, Perplexity und Google AI Overviews, wird die nächste Sau durchs Dorf getrieben.

Die Buzzwords der Stunde: GEO (Generative Engine Optimization) und AEO (Answer Engine Optimization).

Interessant ist, wie diese Begriffe in die Welt kamen. AEO existiert schon länger, entstanden ist er in der Ära der Featured Snippets und Voice Search. GEO wurde Anfang 2025 prominent durch eine These von Andreessen Horowitz (a16z) gepusht und hat sich seitdem in englischsprachigen Fachmedien als Oberbegriff etabliert. Die deutsche Wikipedia-Seite listet GEO inzwischen als Überbegriff „für die Optimierung generativer Suchsysteme insgesamt".

Das ändert aber nichts an meiner Haltung. Als SEOs, die seit Jahren Algorithmen analysieren, müssen wir uns fragen: Brauchen wir wirklich eine neue Schublade für unsere Arbeit, oder ist das hauptsächlich der Versuch, alten Wein in neuen Schläuchen zu verkaufen?

Ich plädiere dafür, den Hype zu ignorieren und stattdessen von AI-Search Optimization (oder einfach: modernem SEO) zu sprechen.

Die technische Begründung ist keine Geschmacksfrage.

Das technische Missverständnis hinter GEO und AEO

GEO und AEO implizieren, dass die Optimierung für generative KI etwas fundamental anderes sei als die Optimierung für eine Suchmaschine. Das ignoriert die technische Realität hinter den aktuellen Systemen.

RAG ist der Schlüssel, nicht die "Engine"

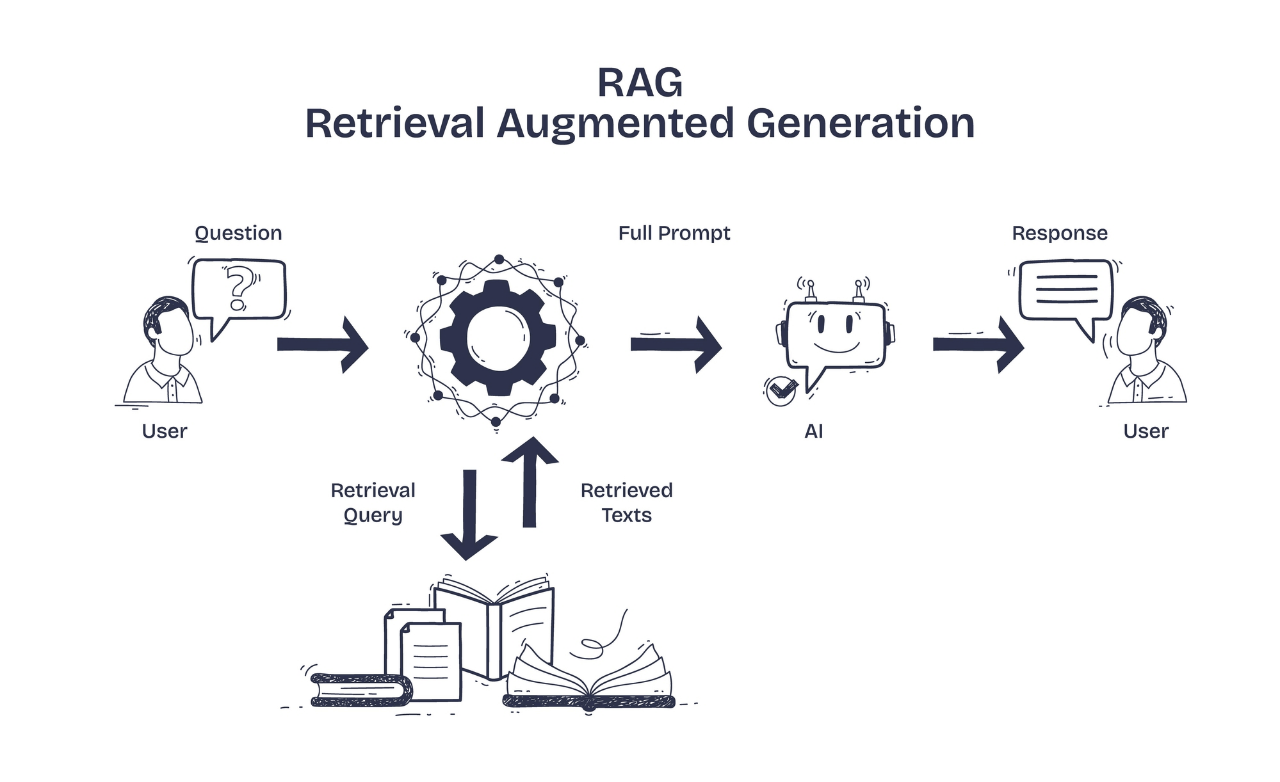

Die meisten aktuellen „Answer Engines" – Google AI Overviews, Perplexity, Bing Copilot – basieren auf Retrieval-Augmented Generation (RAG). Das ist keine Kleinigkeit, sondern der entscheidende Punkt für alles, was folgt.

Konkret läuft das so ab: Gibt ein Nutzer eine Anfrage ein, findet zunächst ein klassischer Information Retrieval Step statt.

Bei Systemen wie Google AI Overviews geschieht das gegen einen vorhandenen Suchindex, das ist klassisches RAG. Bei Perplexity, ChatGPT Search und Bing Copilot kommt ein vorgelagerter Live-Web-Search-Schritt dazu. Googles AI Mode geht noch weiter: Er zerlegt eine Anfrage nach dem Query-Fan-out-Prinzip in mehrere Sub-Fragen und startet dafür parallel dutzende Abfragen ins Live-Web, das ist kein einfaches RAG mehr, sondern ein mehrstufiges Retrieval-Verfahren.

In allen Fällen durchsucht das System anschließend die gefundenen Inhalte nach relevanten Passagen und sogenannten „Chunks", Textfragmenten mit hoher semantischer Ähnlichkeit zur Anfrage. Erst diese Chunks werden als Kontext an das LLM übergeben, das daraus eine kohärente Antwort generiert.

Die Gleichung ist simpel: Kein Retrieval -> Kein Kontext -> Keine Erwähnung!

Wenn du im Retrieval nicht auftauchst, existierst du für die Antwort nicht.

Wer „GEO" als eigenständige Disziplin verkauft, tut so, als könnten wir das LLM direkt beeinflussen. In der Realität optimieren wir nach wie vor primär für den Retrieval-Layer.

Content, der nicht crawlbar, nicht strukturiert und nicht autoritativ genug ist, um indexiert und abgerufen zu werden, landet nie im Prompt und wird damit nie Teil einer generierten Antwort.

Das ist kein neues Problem. Das ist SEO, nur dass der Output jetzt nicht zehn blaue Links sind, sondern ein generierter Absatz.

Ein konkretes Beispiel: Du fragst Perplexity nach dem besten CRM für mittelständische Fertigungsunternehmen. Perplexity sucht intern nach relevanten Quellen, zieht Chunks aus indexierten Seiten, und das LLM synthetisiert daraus eine Antwort inklusive Quellenangaben. Wer in diesem Retrieval-Step nicht auftaucht, existiert für die Antwort nicht. Der Hebel liegt also nicht beim LLM, sondern davor.

Danny Sullivan, jahrelang Googles offizieller Ansprechpartner für SEO, hat es knapper formuliert: „Gute SEO ist gute GEO, oder AEO, AIO, LLM SEO, oder LMNOPO." Der Sarkasmus war Absicht.

Warum die Begriffe strategisch gefährlich sind

Die Einführung separater Begriffe fördert das Silo-Denken, das wir seit Jahren versuchen abzubauen.

Die Gefahr der Fragmentierung

Wenn Unternehmen anfangen, SEO-Budgets von GEO-Budgets zu trennen, entsteht ein strukturelles Problem. Die Zielrichtungen geraten scheinbar in Konflikt:

- SEO zielt auf den Klick: „Besuche die Seite."

- AEO zielt auf die Null-Klick-Antwort: „Beantworte es direkt."

In der Praxis ist das Nutzerbedürfnis hybrid. Jemand bekommt eine schnelle Antwort von Perplexity, klickt dann aber zur Verifizierung auf die zitierte Quelle oder sucht danach direkt nach dem Anbieter. Wer Inhalte nur für das eine oder das andere optimiert, verliert die synergetischen Effekte beider Ansätze.

Hinzu kommt: Die Trennlinie zwischen „AEO" und „GEO" ist fließend. AEO entstand für Featured Snippets und Voice Search. GEO sollte die KI-Ära adressieren. In der Praxis überschneiden sich die empfohlenen Maßnahmen massiv - strukturierte Daten, klare Antwortformate, Entitäten-Optimierung. Wer heute versucht, für beides separate Strategien aufzusetzen, verbringt mehr Zeit mit Begriffspflege als mit der eigentlichen Arbeit.

"AI-Search" vereint die Disziplinen

AI-Search Optimization ist präziser, weil der Begriff anerkennt, was tatsächlich passiert: KI ist ein Feature der Suche, kein neues Medium.

Google ist weiterhin eine Suchmaschine. Perplexity ist eine Suchmaschine mit generativem Output. Bing Copilot ist eine Suchmaschine mit Chatoberfläche. Die Ranking-Signale und die SERP-Darstellung werden durch KI-Modelle beeinflusst, aber das Retrieval-Fundament bleibt dasselbe.

Es geht nicht darum, eine „Generative Engine" zu manipulieren. Es geht darum, die eigene Marke und die eigenen Inhalte so aufzustellen, dass sie in einer KI-gestützten Suche als die valideste, vertrauenswürdigste Antwort erkannt werden. Das ist kein neues Ziel sondern nur eine neue Ausgangslage.

Was sich wirklich ändert und was gleich bleibt

Weg von den Begriffen, hin zu den operativen Implikationen. Was müssen wir bei AI-Search Optimization anders machen?

Das Fundament bleibt

- Crawlability & Indexing: Ohne im Index zu sein, existierst du für das RAG-Modell nicht. Das ist keine Metapher.

- Technische Exzellenz: Rendering und Ladezeiten bleiben relevant. Ein LLM kann keinen JavaScript-Only-Content verarbeiten, der nicht gerendert gecrawlt wurde.

- Backlinks & digitale Autorität: PageRank-Signale bleiben ein Proxy für Vertrauenswürdigkeit. LLMs nutzen Autoritätssignale aktiv, um Halluzinationen zu reduzieren. Wer wenig Autorität hat, wird seltener zitiert, auch wenn der Inhalt besser wäre.

Was sich ändert: die Struktur der Information

Hier liegt der eigentliche Hebel. Weg von „Text für Keywords", hin zu „Daten für Maschinen".

- Entitäten statt Keywords: LLMs denken in semantischen Zusammenhängen und Entitäten-Beziehungen, nicht in Keyword-Matches. Wer sicherstellt, dass Marke, Produkte und Personen als klare Entitäten im Knowledge Graph verankert sind, erhöht die Wahrscheinlichkeit, als Teil einer generierten Antwort aufzutauchen, auch ohne direkten Keyword-Treffer.

- Strukturierte Daten (Schema.org): Schema ist keine Nice-to-Have-Empfehlung mehr. Es ist die Sprache, die sicherstellt, dass das LLM Fakten (Preis, Verfügbarkeit, Autor, Datum) fehlerfrei extrahieren kann. Wer in einem RAG-System als strukturierte Datenquelle erkennbar ist, reduziert die Fehlerrate in der Antwortgenerierung und wird entsprechend bevorzugt zitiert.

- Information Gain: Inhalte, die nur wiederkäuen, was auf Position 1 bis 10 steht, werden von der KI zusammengefasst. Um zitiert zu werden, braucht es Information Gain d.h. neue Daten, einzigartige Perspektiven, exklusive Analysen oder eigene Erfahrungen, die das Modell nirgendwo sonst findet. Das ist die härteste Anforderung, weil sie sich nicht mit einem Plugin lösen lässt.

- Formatierung für Extraction: Direkte Antworten, klare Listen, Tabellen und gut strukturierte Absätze helfen dem System, relevante Chunks leichter zu identifizieren. Nicht weil das LLM Tabellen „mag", sondern weil strukturierte Texte höhere semantische Präzision aufweisen und damit bessere Treffer im Retrieval-Step erzielen.

- Messung neu denken: Das ist der unbequeme Teil: Klassisches Rank-Tracking misst AI-Search-Sichtbarkeit nicht. Wer im AI Overview oder in Perplexity zitiert wird, taucht in Search Console nicht als Klick auf. Neue Kennzahlen wie Brand Mentions in AI-Outputs, Referral-Traffic von KI-Plattformen, direkte Anfragen nach Markennamen, müssen in das Reporting integriert werden. Ahrefs-Daten deuten darauf hin, dass AI Overviews die CTR für Top-Rankings um rund ein Drittel reduziert haben (Stand 2025, Quelle: Ahrefs), während AI-Referral-Traffic von Plattformen wie Perplexity und ChatGPT stark wächst. Die Sichtbarkeit verlagert sich, und ohne neue Messung siehst du den Effekt erst, wenn es zu spät ist.

Fazit: Evolution statt Revolution

Niemand muss sich neu erfinden, und neue Jobtitel braucht es auch nicht. Wer solides technisches SEO mit einem tiefen Verständnis für semantische Suche, Entitäten und Retrieval-Architekturen verbindet, betreibt bereits AI-Search Optimization, egal, ob er es so nennt oder nicht.

GEO und AEO sind primär Marketing-Vehikel. Sie suggerieren eine Komplexität, die oft nur dazu dient, Budgets freizumachen oder Audits zu verkaufen. Das heißt nicht, dass hinter den Begriffen nichts steckt, die Optimierungsmaßnahmen sind real. Aber wer anfängt, SEO-Strategien von GEO-Strategien zu trennen, riskiert genau das Silo-Denken, das er eigentlich überwinden wollte.

Bleibt bei den Basics. Vertieft euer Verständnis von Information Retrieval und LLM-Architekturen. Und lasst euch nicht von jedem neuen Akronym aus dem Konzept bringen.

Am Ende gewinnt immer noch, wer die beste Antwort auf die Frage des Nutzers liefert, egal ob sie über zehn blaue Links oder einen generierten Absatz ausgespielt wird.

Häufige Fragen zum Thema

Was ist der Unterschied zwischen GEO, AEO und AI-Search Optimization?

GEO (Generative Engine Optimization) beschreibt die Optimierung für KI-gestützte Suchsysteme wie Google AI Overviews oder ChatGPT. AEO (Answer Engine Optimization) fokussiert sich enger auf direkte Antwortformate wie Featured Snippets, Sprachassistenten oder strukturierte Direktantworten. AI-Search Optimization ist der übergeordnete Begriff: Er anerkennt, dass KI ein Feature moderner Suchmaschinen ist, kein separates Medium und dass die technischen Grundlagen (Crawlability, Autorität, strukturierte Daten) in allen drei Fällen dieselben sind.

Brauche ich GEO zusätzlich zu SEO?

Nein - zumindest nicht als separate Disziplin. Die Maßnahmen, die für GEO empfohlen werden (Entitäten-Optimierung, strukturierte Daten, Information Gain, klare Antwortformate), sind Bestandteile eines modernen SEO-Ansatzes. Wer klassisches SEO konsequent und technisch sauber umsetzt, betreibt bereits den Kern von GEO.

Warum wird GEO trotzdem so häufig als eigene Disziplin vermarktet?

Weil neue Begriffe neue Budgets freimachen. Das ist kein Zynismus, sondern ein strukturelles Muster in der SEO-Branche, erkennbar an VSO (Voice Search Optimization), Visual Search und anderen Wellen. Die zugrunde liegenden Maßnahmen sind oft real und sinnvoll. Die Behauptung, dass fundamentales neues Fachwissen erforderlich sei, ist es meistens nicht.

Was ist RAG und warum ist es für AI-Search entscheidend?

RAG steht für Retrieval-Augmented Generation. Es ist die Architektur hinter den meisten KI-Suchsystemen: Vor der Antwortgenerierung durchsucht das System einen Index nach relevanten Textfragmenten (Chunks). Diese Chunks werden als Kontext ans LLM übergeben. Wer in diesem Retrieval-Step nicht auftaucht, wird in der Antwort nicht erwähnt, unabhängig von der Qualität der eigenen Inhalte.

Welche Maßnahmen sind für AI-Search Optimization besonders wichtig?

Crawlbarkeit und Indexierbarkeit bleiben Grundvoraussetzung. Darüber hinaus sind Entitäten-Verankerung im Knowledge Graph, strukturierte Daten (Schema.org), Information Gain (einzigartige Inhalte, die über vorhandenes Ranking-Material hinausgehen) und klare Extraktionsformate (Listen, Tabellen, direkte Antworten) die relevanten Hebel.

Kommentare