Dark Keywords, GSC-Datenlücken und die KI-Suche: Was du wirklich weißt - und was nicht

Der meiste organische Traffic kommt von Suchanfragen, die kein Tool je erfasst. Das ist kein temporäres oder schnell lösbares Problem, sondern ein strukturelles Merkmal der Suche. Und die KI-Transformation macht es nicht besser.

Der meiste Traffic kommt von Keywords, die du in deinen Analysetools gar nicht sehen kannst. Das sind die sogenannten „Dark Keywords", Suchanfragen, die Klicks und Impressionen generieren, aber in keiner Auswertung auftauchen. Kein Einzelfall, kein Datenfehler, sondern ein strukturelles Merkmal der modernen Suche. Und die KI-Transformation verschärft das Problem weiter.

tl;dr

Die Kernaussagen auf einen Blick.

Der meiste organische Traffic kommt von Suchanfragen, die in keinem deiner Analysetools auftauchen. Aus zwei Gründen: Google blendet seltene Anfragen aus Datenschutzgründen aus der GSC aus, und Drittanbieter-Tools kennen Zero-Volume- und neue Keywords schlicht nicht – mangels Volumen und wegen ihrer historischen Datenbasis. Diese Lücke ist kein Bug, sondern System, und sie wird durch AI Overviews und Query Fan-Out größer, nicht kleiner.

Kernfakten:

- 15 % aller täglichen Google-Suchanfragen wurden noch nie zuvor gestellt - genau diese Zero-Volume-Keywords landen als anonymisierte Anfragen in der GSC.

- In Deutschland erscheinen AI Overviews laut SE-Ranking-Studie (100.000 Keywords, Mai 2025) bei rund 28 % der Suchanfragen, mit deutlich höheren Anteilen in Gesundheit (über 80 %) und anderen informationsgetriebenen Nischen.

- SEO-Tools arbeiten mit Schätzungen und sind strukturell blind für Dark Keywords. Einzige echte First-Party-Quelle: Die GSC-API.

- Seit dem 12. September 2025 liefern Drittanbieter-Tools keine verlässlichen Ranking-Daten mehr jenseits von Position 20. Google hat den &num=100-Parameter deaktiviert.

- Query Fan-Out zerteilt Nutzeranfragen hinter den Kulissen in synthetische Unterabfragen. Die gemeldeten Keywords in der GSC sind nicht mehr zwingend die ursprünglichen Nutzereingaben.

→ Im Hauptartikel: Keyword-Taxonomie, GSC-Limitierungen und der September-2025-Einschnitt, Query Fan-Out-Mechanik, AI Search Optimization (GEO/AEO), E-E-A-T für KI-Zitierbarkeit

Was sind Dark Keywords wirklich?

Der Begriff „Dark Keywords" ist in der SEO-Branche kein standardisierter Fachterminus wie „Long-Tail-Keywords" oder „Seed-Keywords". Er wird oft unscharf verwendet, mal für statistisch unsichtbare Suchbegriffe, mal für die allgemeine Datenverschleierung durch Google. Ich fasse ihn hier in zwei Kategorien zusammen:

1. Datenschutzverschleierte Keywords: Das sind Suchanfragen, die Impressionen und Klicks generieren, aber in der Google Search Console aufgrund von Datenschutzschwellen nicht einzeln ausgewiesen werden. Das ist die primäre Bedeutung – eine direkte Folge von Googles (not provided)-Politik.

2. Statistisch unsichtbare Keywords: Hyper-Long-Tail- und Zero-Search-Volume-Keywords. So selten oder so neu, dass Keyword-Datenbanken von Drittanbieter-Tools sie schlicht nicht erfassen. Aus Planungssicht effektiv unsichtbar.

Diese beiden Kategorien hängen direkt zusammen. Die statistisch unsichtbaren Keywords sind exakt die Anfragen, die am ehesten zu datenschutzverschleierten Einträgen in der GSC werden – weil sie die Meldeschwellen nicht erreichen.

Googles Datenschutz-Argument und seine Schwächen

Google begründet die eingeschränkte Datenverfügbarkeit offiziell mit dem Schutz der Nutzerprivatsphäre. Das Argument: Zu spezifische Suchanfragen könnten Rückschlüsse auf Einzelpersonen zulassen. Diese Logik wurde mit datenschutzbedingten Schwellenwerten formalisiert – Begriffe unterhalb eines bestimmten Suchvolumens verschwinden aus Analyse-Tools als (not provided).

Das klingt vernünftig, bis man sich die Gegenseite anschaut: Google selbst hat uneingeschränkten Zugriff auf sämtliche Suchanfragen und nutzt diese aktiv für Werbepersonalisierung, Ranking-Optimierung und das Training eigener KI-Modelle. Die gleichen Daten, die Websitebetreibern vorenthalten werden, fließen in Produkte, von denen Google direkt profitiert.

Ob das reine Datenschutzpolitik ist oder eine strategisch vorteilhafte Informationsasymmetrie, diese Frage darf jeder selbst beantworten.

Fest steht: Die Abhängigkeit von Google-eigenen Produkten wie Ads und der Search Console wird durch diese Intransparenz jedenfalls nicht kleiner.

Long Tail, Hyper-Long-Tail und das 15-%-Prinzip

Um die Dimension des Problems zu verstehen, hilft ein Blick auf die Suchnachfragekurve. Keywords lassen sich grob einteilen in Short-Tail (ein bis drei Wörter, hohes Volumen), Long-Tail (spezifisch, niedriges Volumen) und den Hyper-Long-Tail - also alles, was so selten gesucht wird, dass Tools ein monatliches Volumen von null angeben.

„Null" bedeutet dabei nicht, dass niemand sucht. Es bedeutet: Die Suchhäufigkeit liegt unterhalb der Meldeschwelle oder die Anfrage ist so neu, dass keine historischen Daten vorliegen.

Laut Google werden täglich 15 % aller Suchanfragen zum ersten Mal gestellt - dieser Anteil ist per Definition unsichtbar für jedes tool-basierte Recherchesystem.

Diese Dunkelheit ist kein Fehler im System. Sie ist eine strukturelle Bedingung, die aus der unendlichen Ausdrucksvielfalt der Nutzer und den Datenschutzfiltern von Google entsteht.

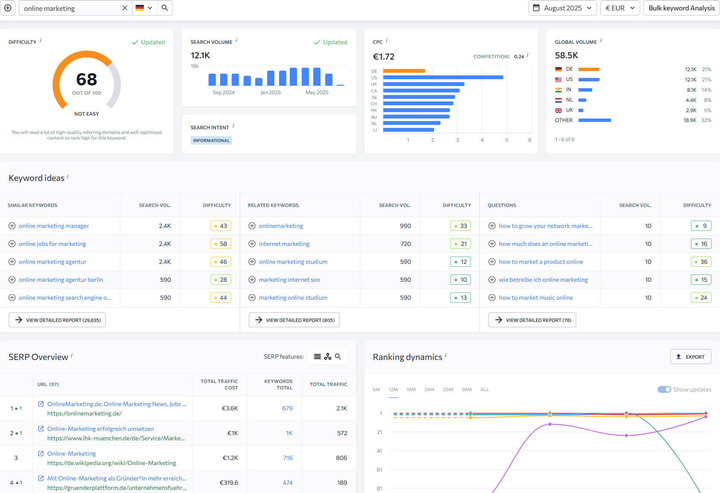

Suchnachfragekurve (Long-Tail-Konzept)

Long-Tail-Keywords verstehen:

Head Keywords: Wenige Keywords mit sehr hohem Suchvolumen (z.B. "Auto kaufen" - 100.000+ Suchanfragen/Monat)

Middle Keywords: Moderate Anzahl mit mittlerem Volumen (z.B. "gebrauchtes Auto München" - 1.000-10.000 Suchanfragen/Monat)

Long-Tail Keywords: Viele spezifische Keywords mit niedrigem Volumen (z.B. "günstiger blauer BMW 3er München Automatik" - <100 Suchanfragen/Monat)

Die Kurve zeigt: Obwohl jedes Long-Tail-Keyword wenig Traffic hat, bilden sie zusammen die Mehrheit aller Suchanfragen und des organischen Traffics.

| Konzept | Definition | Primäre Herausforderung |

|---|---|---|

| Datenschutzverschleierte Keywords | Suchanfragen, die Traffic generieren, aber in der GSC nicht einzeln ausgewiesen werden | Datendiskrepanz und Attributionslücke |

| Hyper-Long-Tail-Keywords | Hochspezifische Suchanfragen mit mehreren Wörtern und sehr geringem individuellem Suchvolumen | Entdeckung und Skalierbarkeit |

| Zero-Search-Volume-Keywords | Von SEO-Tools mit 0 Suchanfragen/Monat ausgewiesene Begriffe – oft neu, nischenhaft oder unter Meldeschwellen | Rechtfertigung und Priorisierung |

Die Black Box GSC: Warum deine Keyword-Daten immer lückenhaft bleiben

Anonymisierte Anfragen: Das strukturelle Problem

Die Google Search Console ist das primäre Werkzeug zur Analyse der organischen Suchleistung – aber kein vollständiges Abbild der Realität. Aus Datenschutzgründen lässt sie absichtlich Suchanfragen weg, die potenziell einzelne Nutzer identifizierbar machen könnten. In der Praxis sind das sehr seltene oder extrem spezifische Long-Tail-Suchen, die über einen Zeitraum von zwei bis drei Monaten nur wenige Dutzend Nutzer gestellt haben.

Das führt zu einer messbaren Datendiskrepanz: Die Summe aller Klicks und Impressionen für einzeln ausgewiesene Suchanfragen stimmt fast nie mit den Gesamtwerten einer Seite überein. Die Differenz ist der Traffic von anonymisierten, unsichtbaren Anfragen.

Ein konkretes Beispiel: Die Klicks aus allen aufgelisteten Suchanfragen ergeben 4.500 - der Gesamtwert für die Seite liegt bei 5.500. Die fehlenden 1.000 Klicks stammen von Dark Keywords.

Dieses Problem verschärft sich, sobald Filter gesetzt werden. Jeder Filter in der GSC-Oberfläche - nach Suchanfrage, Land oder Gerät - entfernt alle Daten anonymisierter Anfragen aus den Gesamtsummen. Das Ergebnis sind scheinbar dramatische Einbrüche in den Zahlen, die in Wirklichkeit nur ein Filterproblem sind.

Die 1.000-Zeilen-Grenze und der API-Workaround

Die Benutzeroberfläche der GSC zeigt maximal 1.000 Datenzeilen – für Suchanfragen, Seiten und alle anderen Dimensionen – absteigend nach Klicks sortiert. Für größere Websites bedeutet das: alles jenseits der Top 1.000 ist durch die Oberfläche nicht zugänglich. Potenzielle Optimierungskandidaten auf Seite 2 der SERPs bleiben systematisch unsichtbar.

Die einzige Möglichkeit, auf einen größeren Datensatz zuzugreifen, ist die Search Analytics API. Sie liefert bis zu 50.000 Zeilen pro Tag und Property. Wichtig: Auch die API unterliegt denselben Datenschutzfiltern. Sie enthüllt keine anonymisierten Dark Keywords, sondern erweitert nur die Stichprobe der sichtbaren Anfragen. Für seriöse Keyword-Analysen führt kein Weg an der API vorbei.

Sekundäre Metriken mit Vorsicht behandeln

Neben den strukturellen Datenlücken unterliegen auch Kernmetriken systemischen Verzerrungen:

Durchschnittliche Position: Besonders irreführend bei Anfragen mit wenigen Impressionen. Wer wiederholt nach der eigenen Marke sucht, hebt die durchschnittliche Position künstlich auf 1,0. Die Metrik wird erst bei hohen Impressionszahlen statistisch aussagekräftig.

Aufgeblähte Impressionen: Sitelinks bei Markensuchen zählen für Homepage und alle verlinkten Unterseiten als separate Impression. Da Nutzer fast immer auf den Hauptlink klicken, verzerrt das die CTR der Unterseiten systematisch nach unten.

Datenlimits: Die GSC speichert maximal 16 Monate. Ältere Daten werden gelöscht. Geografische Filterung ist nur auf Länderebene möglich, nicht nach Städten oder Regionen – ein echtes Problem für lokale Unternehmen.

Die GSC ist kein umfassendes Analysetool. Sie ist ein Gesundheitsmonitor: die genauesten verfügbaren Richtungsdaten direkt von der Quelle, aber keine absolute Wahrheit. Ihre Zahlen als Fakten zu behandeln ist ein strategischer Fehler.

Update September 2025: Der &num=100-Einschnitt

Am 12. September 2025 hat Google den &num=100-Parameter deaktiviert. Dieser Parameter erlaubte es SEO-Tools und Crawlern, bis zu 100 Suchergebnisse pro Anfrage abzurufen - was täglich massenhafte automatisierte Ranking-Messungen ermöglichte. Mit seiner Abschaltung verloren Drittanbieter-Tools jegliche verlässliche Datenbasis jenseits von Position 20.

Die unmittelbaren Auswirkungen: Impressionen in der GSC brachen über Nacht ein, durchschnittliche Positionen veränderten sich, die Anzahl gemeldeter Suchanfragen verschob sich - ohne dass sich irgendwas an den tatsächlichen Rankings geändert hätte.

Was wegfiel, waren die Impressionen, die Bot-Crawler generiert hatten, nicht die echter Nutzer.

Im Ergebnis sind GSC-Daten seit dem 13. September 2025 in einer Hinsicht präziser: Sie spiegeln reale menschliche Suchaktivität besser wider als vorher. Historische Vergleiche vor diesem Datum sind ohne Berücksichtigung dieses Schnitts wertlos.

Und für SEO-Tools gilt seitdem: Ranking-Tracking jenseits der Top 20 ist strukturell kaum noch möglich.

Warum SEO-Tools Dark Keywords strukturell nicht sehen können

First-Party vs. Third-Party: Der grundlegende Unterschied

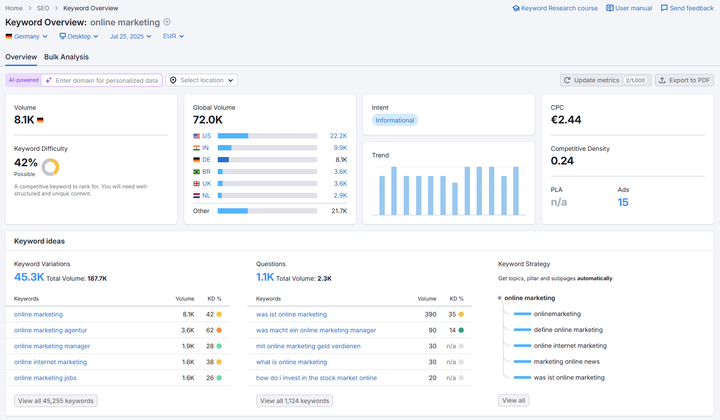

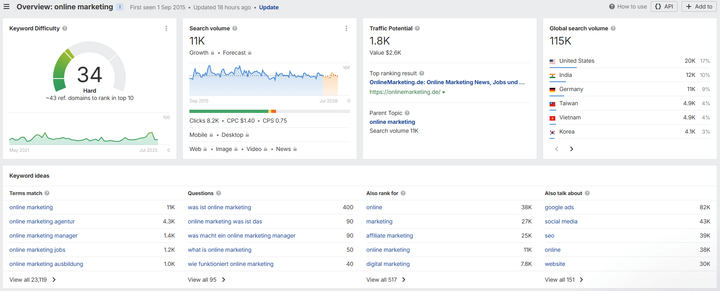

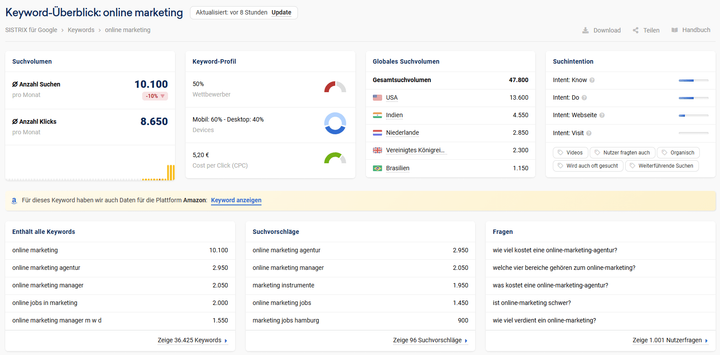

Wer die Rolle von SEO-Plattformen wie Sistrix, SE Ranking oder Ahrefs verstehen will, muss die Unterscheidung zwischen ihren Daten und denen der GSC kennen.

First-Party-Daten (GSC): Reale, beobachtete Klicks und Impressionen aus Googles eigenen Protokollen. Gefiltert und als Stichprobe, aber direkt von der Quelle.

Third-Party-Daten (SEO-Plattformen): Diese Tools crawlen das Web, bauen Keyword-Datenbanken auf und beobachten, welche Website für welches Keyword rankt. Aus Ranking-Position und geschätztem Suchvolumen berechnen sie den geschätzten organischen Traffic.

Diese unterschiedlichen Methoden führen zwangsläufig zu Abweichungen - sowohl untereinander als auch gegenüber der GSC. Das ist kein Qualitätsproblem dieser Tools, sondern eine strukturelle Eigenschaft ihrer Datenbasis.

Das Suchvolumen als Schätzgröße

Das Suchvolumen ist in keinem Drittanbieter-Tool eine direkte Messung. Es ist eine Schätzung, oft basierend auf Daten aus dem Google Ads Keyword Planner - einem Tool, das für Werbetreibende konzipiert wurde, nicht für die Analyse organischen Suchverhaltens. Mehr dazu in meinem Beitrag über den Keyword Planner und seine Grenzen.

Der entscheidende blinde Fleck: Zero-Search-Volume- und neu aufkommende Keywords. Da diese Datenbanken auf historischen Daten beruhen, kann ein Begriff, der gerade an Popularität gewinnt, noch wochenlang ein Volumen von null ausweisen. Für Dark Keywords bedeutet das: Diese Tools können nur zeigen, was bereits bekannt ist und eine messbare Vergangenheit hat.

Wofür Drittanbieter-Tools trotzdem unverzichtbar sind

Trotz dieser Grenzen sind diese Plattformen für bestimmte Aufgaben nicht zu ersetzen:

Wettbewerbsanalyse: Sie sind hervorragend darin, die Keyword-Strategie von Wettbewerbern zu rekonstruieren, Content-Lücken zu identifizieren und herauszufinden, für welche Keywords Konkurrenten ranken, du aber nicht.

Backlink-Recherche: Ahrefs ist in der Backlink-Analyse Marktführer und bietet einen weitaus umfassenderen Überblick als die GSC.

Keyword-Ideenfindung: Aus einem Seed-Keyword eine Fülle verwandter Begriffe zu generieren und nach Schwierigkeit zu filtern - das leisten diese Tools gut.

| Attribut | Google Search Console | Drittanbieter-Plattformen |

|---|---|---|

| Datenquelle | First-Party aus Google-Protokollen | Third-Party aus Web-Crawling und Clickstream-Panels |

| Schlüsselmetriken | Tatsächliche Klicks und Impressionen | Geschätzter Traffic und geschätztes Suchvolumen |

| Genauigkeit | Hoch für das Angezeigte, aber Stichprobe und datenschutzgefiltert | Richtungsweisend, modellbasiert |

| Scope | Nur die eigene Website | Jede beliebige Website inklusive Wettbewerber |

| Primärer Anwendungsfall | Performance-Messung, technische Diagnose | Wettbewerbsanalyse, Backlinks, Keyword-Ideenfindung |

| Dark-Keyword-Blinder Fleck | Anonymisiert Anfragen mit geringem Volumen | Meldet keine Zero-Volume- oder neuen Suchanfragen |

Eine tragfähige SEO-Strategie braucht daher einen hybriden Ansatz: Drittanbieter-Tools kartieren die bekannte Wettbewerbslandschaft, die GSC misst die tatsächliche Performance für den sichtbaren Teil davon, und qualitative Methoden erkunden den Raum, den beide systematisch verfehlen.

Was die KI-Suche aus dem Datenproblem macht

AI Overviews und das Zero-Click-Problem

Die Einführung von Google AI Overviews (vormals Search Generative Experience) markiert eine grundlegende Verschiebung. Google wird zunehmend zur Antwortmaschine: AI Overviews sind KI-generierte Zusammenfassungen, die direkt oben auf der Suchergebnisseite erscheinen und die Nutzeranfrage oft vollständig beantworten, ohne dass jemand eine externe Website besucht.

Die Datenlage für Deutschland: Eine SE-Ranking-Studie von Mai 2025 (100.000 Keywords aus 20 Branchen) hat ermittelt, dass AI Overviews bei rund 28 % aller analysierten deutschen Suchanfragen erscheinen. In informationsgetriebenen Branchen wie Gesundheit liegt der Anteil bei über 80 %, in Sport und Fitness bei knapp 60 %. Bei rein transaktionalen oder navigationalen Anfragen sind AI Overviews deutlich seltener.

Zum Vergleich: Frühe Zahlen aus US-Tests der Search Generative Experience (2024) lagen teils bei 86–91 % – diese Werte spiegeln eine Testphase unter US-Laborbedingungen wider, nicht die heutige Realität in Deutschland.

Was AI Overviews konkret mit dem Traffic machen, ist mittlerweile gut belegt. Eine DACH-Studie von Smartlemon (Dezember 2025, basierend auf GSC-Daten) zeigt einen CTR-Rückgang von durchschnittlich 44 % für Suchanfragen mit AI Overview – verglichen mit den Werten vor deren Einführung am 26. März 2025 in Deutschland. Kurz nach dem Launch hatte der gleiche Datensatz noch „nur" 12 % Rückgang gezeigt. Der Effekt verstärkt sich also mit der Nutzungsgewöhnung.

Wichtig für die Einordnung: Diese Rückgänge betreffen primär informationsgetriebene Anfragen. Transaktionale und lokale Suchen sind bislang deutlich weniger betroffen.

Neue Messprobleme durch die KI-Integration

Googles KI-Funktionen schaffen ein neues Mess-Paradoxon in der GSC. Klicks und Impressionen aus AI Overviews und dem neuen AI Mode fließen in den Standard-Leistungsbericht unter dem Suchtyp „Web" ein – ohne Möglichkeit, sie zu segmentieren. Eine Website kann gleichzeitig in einer AI Overview als Quelle zitiert werden und im klassischen organischen Ergebnis auftauchen. GSC-Impressionen und CTR messen dann eine Mischung aus beidem, ohne dass du wissen kannst, in welchem Verhältnis.

Das bedeutet: Sinkende CTR-Werte in der GSC können ein Signal für steigende AIO-Präsenz sein – oder auch nicht. Ohne externe Tools, die explizit AIO-Auftritte tracken, lässt sich das aus GSC-Daten allein nicht herleiten.

Query Fan-Out: Wenn die KI die Anfrage umbaut

Ein konzeptionell wichtiger Mechanismus hinter der generativen Suche ist Query Fan-Out. Wenn ein Nutzer eine komplexe, konversationelle Frage stellt, zerlegt Googles KI diese Anfrage intern in mehrere kleinere, synthetische Unterabfragen. Die Ergebnisse dieser Unterabfragen werden dann zu einer einzigen kohärenten Antwort im AI Overview zusammengeführt.

Was das für Keyword-Daten bedeutet: Das in der GSC gemeldete Keyword muss nicht mehr die ursprüngliche Eingabe des Nutzers sein. Es kann eine der synthetischen Unterabfragen sein, die Google selbst generiert hat. Die Verbindung zwischen Nutzerabsicht und gemeldeten Daten wird dünner - und Dark Keywords werden noch dunkler.

AI Search Optimization: Was das alles erzwingt

Diese Entwicklungen machen eine eigene Disziplin notwendig: AI Search Optimization - oder, in der Terminologie, die sich in anderen Teilen der Branche durchsetzt, Generative Engine Optimization (GEO) und Answer Engine Optimization (AEO). Das Ziel verschiebt sich: Nicht mehr nur ranken, sondern als vertrauenswürdige Quelle in der KI-generierten Antwort zitiert werden.

Erfolgsmetriken wandeln sich entsprechend. Klickrate verliert Bedeutung gegenüber AIO-Sichtbarkeit und Zitierrate durch KI-Systeme. Wer in einem AI Overview als Quelle erscheint, profitiert auch ohne Klick von gesteigerter Markenbekanntheit. Aber die Messung dieser „Referenzrate" ist heute noch deutlich unausgereifter als klassisches Ranking-Tracking.

Das alte Modell – Nutzer tippt Keyword, Website rankt, Klicks werden gemessen – ist in seiner Reinform nicht mehr vollständig belastbar. Reaktive, keyword-basierte Optimierung verliert ihren Wirkungsgrad. Wer diesen Wandel ausschließlich als Bedrohung sieht, übersieht, dass er auch Chancen schafft: Seiten, die als Quelle in AI Overviews zitiert werden, verzeichnen nach einer Analyse von BluShark Digital eine um rund 38 % höhere CTR auf ihre organischen Ergebnisse als nicht zitierte Seiten.

Strategien für die Navigation im Dunkeln: Von Keyword-Optimierung zu thematischer Autorität

Die Antwort auf Dark Keywords und KI-Fragmentierung ist nicht, noch mehr Zeit in die Analyse einzelner Suchbegriffe zu investieren. Die Antwort ist, Themengebiete so umfassend zu besetzen, dass die Absenz einzelner Daten weniger ins Gewicht fällt.

Das Pillar-Cluster-Modell

Das effektivste Konzept für diese Strategie ist das Pillar-Cluster-Modell. Eine zentrale „Pillar-Seite" behandelt ein breites Thema in seiner Gesamtheit. Zahlreiche „Cluster-Seiten" vertiefen spezifische Unterthemen, Long-Tail-Fragen und Nischenaspekte. Die Verknüpfung erfolgt durch strukturierte interne Verlinkung.

Dieser Aufbau fängt auf natürliche Weise Traffic von Long-Tail- und Dark Keywords ab, ohne dass du diese Keywords explizit kennen musst. Der Mechanismus dahinter: Eine Website, die ein Thema in seiner Breite und Tiefe abdeckt, positioniert sich als maßgebliche Ressource – für Nutzer und für KI-Systeme gleichermaßen. Je umfassender die thematische Abdeckung, desto geringer die Abhängigkeit von einzelnen, messbaren Keywords.

Wo du Fragen findest, die kein Tool kennt

Da klassische Tools Dark Keywords strukturell nicht aufdecken können, sind qualitative Methoden unverzichtbar.

Google SERP-Funktionen: People Also Ask (PAA), Autocomplete und „Ähnliche Suchanfragen" liefern direkte Einblicke in reale Nutzerpfade. Tools wie AlsoAsked helfen, die hierarchischen Beziehungen zwischen PAA-Fragen zu visualisieren – nützlich für die Content-Architektur.

Community-Plattformen: Reddit und Quora sind eine der zuverlässigsten Quellen für die exakte Sprache, die Schmerzpunkte und die offenen Fragen deiner Zielgruppe. Diese Fragen erscheinen oft nie in einem Keyword-Tool, weil sie zu spezifisch oder zu neu sind. Trotzdem sind sie real – und oft wichtig.

Interne Website-Suche: Die Suchprotokolle der eigenen Website zeigen die Nutzerabsicht in ihrer direktesten Form: was suchen Menschen, die bereits auf der Seite sind? Anfragen ohne Ergebnisse („zero-result queries") sind ein direkter Hinweis auf Content-Lücken.

Content-Architektur für AI Search (AI Search Optimization/GEO-Taktiken)

Um von AI Overviews und LLMs als Quelle ausgewählt zu werden, muss Inhalt für maschinelle Verarbeitung geeignet sein:

Klare Struktur: Eine logische Hierarchie mit aussagekräftigen Überschriften (H1, H2, H3) hilft KI-Systemen, Inhaltsstruktur und Relevanz zu erkennen.

Listen und Tabellen: Prozesse, Vergleiche und Daten in Listen- oder Tabellenformat sind für LLMs leicht extrahierbar und wiederverwendbar.

Modulare Abschnitte: Inhalte sollten in in sich geschlossene Einheiten unterteilt sein, die jeweils eine spezifische Unterabsicht beantworten. Sprunglinks und FAQ-Bereiche unterstützen diese Struktur.

Strukturierte Daten (Schema Markup): FAQPage, HowTo, Article - diese Schema-Typen teilen KI-Systemen explizit mit, womit sie es zu tun haben. Sie erhöhen die Wahrscheinlichkeit, in Rich Snippets und AI Overviews berücksichtigt zu werden.

| Taktik | Warum sie für AI Search funktioniert | Implementierungsbeispiel |

|---|---|---|

| Themencluster aufbauen | Demonstriert umfassende Autorität, deckt viele Dark Keywords ab | Pillar-Seite zu „SEO" mit Cluster-Seiten zu Keywords, Backlinks, technischem SEO |

| People Also Ask analysieren | Zielt auf nachweislich verwandte Fragen ab, die KI-Modelle zur Kontextualisierung nutzen | Mit AlsoAsked Fragennetzwerk zum eigenen Thema visualisieren |

| Konversationelle Überschriften verwenden | Passt zu Sprachsuche-Mustern und KI-Anfragen | Statt „Laufschuh-Haltbarkeit": „Wie lange halten Laufschuhe?" |

| HowTo-Schema implementieren | Maschinenlesbares Schritt-für-Schritt-Format für Anleitungsanfragen | Jeden Prozessschritt im Schema-Markup einzeln beschreiben |

| Daten in Tabellen strukturieren | Leicht verdauliche Datenpunkte für Vergleichsanfragen | Vergleichstabelle mit Preisen und Funktionen verschiedener Tarife |

| Interne Verlinkung nutzen | Stellt semantische Beziehungen her, hilft KI beim Verstehen der Site-Struktur | Von Keyword-Beitrag auf Pillar-Seite zur Keyword-Recherche verlinken |

E-E-A-T und Markensignale: Die Währung der KI-Ära

In einer Suchwelt, in der Algorithmen und KI-Systeme Quellen auswählen, werden E-E-A-T-Kriterien – Expertise, Experience, Authoritativeness, Trustworthiness – zum entscheidenden Differenzierungsmerkmal.

Konkret bedeutet das: echte Erfahrung dokumentieren, glaubwürdige Quellen zitieren, Autoren mit nachweisbarer Expertise präsentieren, Markenreputation durch Bewertungen, Testimonials und Erwähnungen auf vertrauenswürdigen Websites aufbauen. Das klingt nach Standard-SEO-Ratschlägen, ist aber in der KI-Suche entscheidend: LLMs gewichten Quellen nach Autorität und Vertrauenswürdigkeit – eine stark referenzierte Marke wird häufiger zitiert als eine unbekannte, auch wenn die Inhalte vergleichbar sind.

Die Markenautorität selbst wird zum eigenständigen Rankingsignal. Das heißt auch: Offline-Reputation, Presse-Erwähnungen und Branchenvernetzung zahlen heute stärker auf SEO-Sichtbarkeit ein als noch vor drei Jahren.

Das Toolkit: Was wirklich hilft

Fundamentale Plattformen

Google Search Console: Erste Anlaufstelle für First-Party-Leistungsdaten. Fokus auf die API-Extraktion, um die 1.000-Zeilen-Grenze zu umgehen. Analyse auf Seiten- und Verzeichnisebene statt auf Keyword-Ebene – einzelne Keywords sind, wie gezeigt, zu lückenhaft für verlässliche Schlussfolgerungen. Seit September 2025 gelten die Daten als genauer, aber historische Vergleiche über diesen Datenschnitt hinweg sind ohne Bereinigung wertlos.

Sistrix, SE Ranking, Ahrefs: Unverzichtbar für Wettbewerbsanalyse, Themenentdeckung und Backlink-Recherche. Keyword-Lückenanalyse und Themenrecherche sind die primäre Stärke – nicht das Messen absoluter Performance.

Tools zur Themen- und Fragenentdeckung

AlsoAsked, AnswerThePublic: Spezialisierte Tools für PAA- und Autocomplete-Daten. Helfen, Nutzerpfade zu verstehen und Content-Strukturen zu entwickeln.

Forum- und Community-Analyse: Reddit, Quora, branchenspezifische Foren. Hier findet man die authentische Sprache der Zielgruppe - oft in Form von Fragen, die kein Keyword-Tool je erfassen wird.

Interne Suchanalytik in GA4: Eine der meistunterschätzten Datenquellen. Nutzerabsichten direkt von Besuchern, die bereits auf der eigenen Seite sind - ungefilterter als jede externe Quelle.

AI-Sichtbarkeit tracken

Da die GSC keine segmentierten Daten für AI Overviews liefert, sind Drittanbieter-Tools für diesen Bereich notwendig geworden. Ahrefs, Sistrix und SEOmonitor bieten Funktionen, um zu identifizieren, welche Keywords AI Overviews auslösen und welche Websites darin zitiert werden. Kein dieser Tools ist perfekt, aber ohne sie tappt man bei der AI-Search-Optimierung vollständig im Dunkeln.

SEOmonitor, Keyword Insights: Content-Optimierungsplattformen, die Inhalte auf Basis von SERP-Analysen strukturieren. Empfehlungen zu semantisch verwandten Begriffen und Formatierungsvorschläge werden für AI Search relevanter.

Der Workflow

Ein funktionierender Prozess für die Dark-Keywords-Ära sieht in der Praxis so aus:

- Identifizieren: Mit einem Drittanbieter-Tool (z. B. Sistrix) Keywords identifizieren, die häufig AI Overviews auslösen und für das eigene Themengebiet relevant sind.

- Priorisieren: Diese Liste gegen die leistungsstärksten Seiten in der GSC abgleichen – hohe Impressionen, aber sinkende CTR sind ein Indikator für AIO-Konkurrenz.

- Optimieren: Priorisierte Seiten nach AI-Search-Prinzipien überarbeiten: klare Struktur, Listen, Tabellen, Schema-Markup.

- Messen: Leistungstrends auf aggregierter Seitenebene beobachten, nicht auf Keyword-Ebene. Einzelne Keywords sind zu fragmentiert für belastbare Schlussfolgerungen.

Fazit: Im Dunkeln navigieren lernen

Dark Keywords sind kein vorübergehendes Phänomen. Sie sind eine dauerhafte Bedingung, die aus dem Zusammenspiel von Datenschutzpolitik, statistischer Natur des Long Tails und KI-getriebener Suchabstraktion entsteht. Die Fähigkeit, Performance auf Keyword-Ebene zu tracken, wird weiter abnehmen – durch GSC-Datenschutzfilter, den &num=100-Einschnitt, AI Overviews und Query Fan-Out.

Was das bedeutet: Wer SEO noch überwiegend als Keyword-Management betreibt, misst zunehmend Schatten statt Wirklichkeit. Die Alternative ist thematische Autorität: Themengebiete so umfassend und substanzreich besetzen, dass Dark Keywords organisch abgedeckt werden, ohne dass man sie kennen muss.

Neue Metriken werden relevanter: AIO-Sichtbarkeit, Zitierrate durch KI-Systeme, Share of Model. Kein dieser Werte lässt sich heute so präzise tracken wie organische Rankings. Das ist unbefriedigend, aber es ist die Realität – und wer sie akzeptiert, statt zu verdrängen, ist besser positioniert als wer weiter auf Keyword-Präzision setzt, die strukturell nicht mehr lieferbar ist.

Kommentare