Veröffentlicht in der Kategorie AI-Search.

Mount AI: Wenn dein AI-Content-Tool deine Sichtbarkeit vernichtet

Geschrieben von Carsten Feller am .

75 Prozent der Vorzeigekunden eines populären AI-Content-Tools haben massive Rankingverluste erlitten. Die Toolbetreiber wissen das. In ihren Verkaufsmaterialien steht es nicht.

tl;dr

„Mount AI" bezeichnet die typische Sichtbarkeitskurve von Websites, die massenhaft KI-generierten Content ohne Qualitätskontrolle veröffentlichen: steil nach oben, dann senkrecht runter. Analysen von Tomek Rudzki und Malte Landwehr zeigen, dass bei einem der untersuchten AI-Content-Tools 75 Prozent der eigenen Case-Study-Kunden signifikante Sichtbarkeitsverluste erlitten haben. Der Aspekt, den die meisten übersehen: Ein Google-Penalty macht eine Domain heute nicht nur in der traditionellen Suche unsichtbar, sondern gleichzeitig auch in ChatGPT, Perplexity und AI Overviews. Die Hoffnung, über AI-Search als Backup-Kanal zu überleben, ist empirisch widerlegt. Automatisierungs-Pipelines aus n8n-Workflows und LinkedIn-Templates verschärfen das Problem, weil sie nicht primär an bewusste Affiliate-Spieler verkauft werden, sondern an Unternehmen mit echter Reputation.

Definition: Mount AI

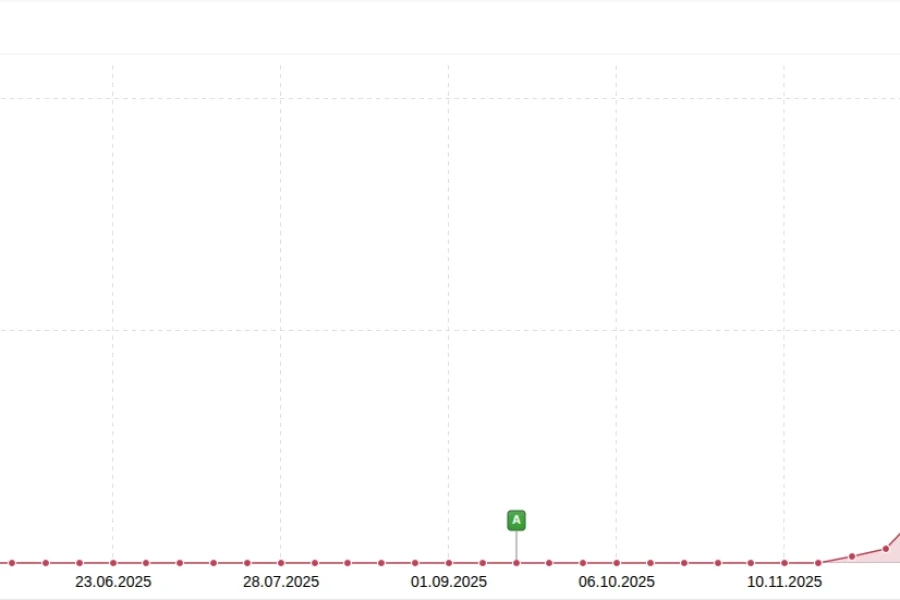

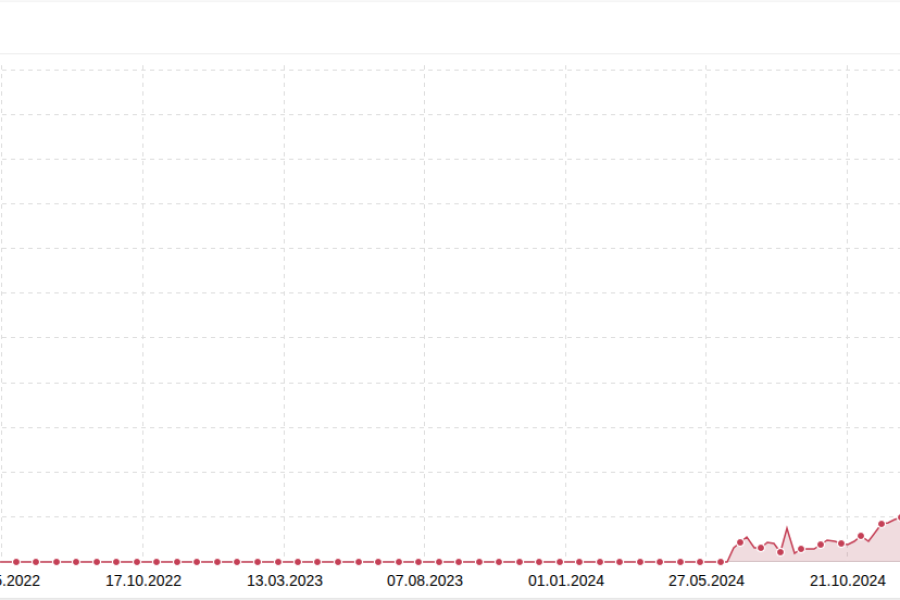

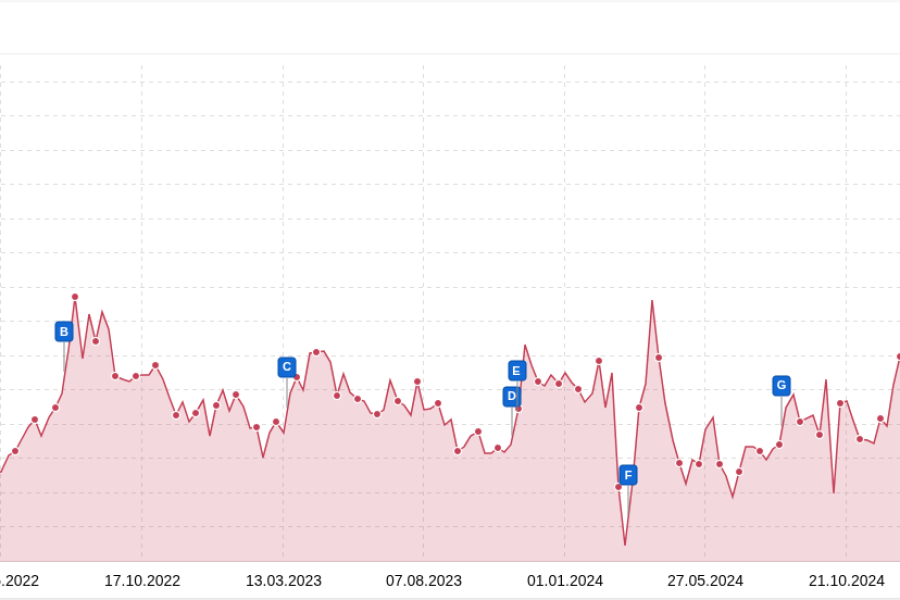

Es gibt ein Muster, das viele SEOs inzwischen auf den ersten Blick erkennen, wenn sie Sichtbarkeitskurven sehen:

Der Begriff „Mount AI" bezeichnet eine spezifische, nicht nachhaltige Sichtbarkeitskurve in SEO-Analyse-Tools wie Sistrix. Er beschreibt das Muster von Websites, die durch den massiven, unfiltrierten Einsatz von KI-generierten Inhalten in kürzester Zeit einen extrem steilen Anstieg der Rankings verzeichnen, nur um bei einem nachfolgenden Google Core oder Spam Update ebenso steil wieder abzustürzen. Die resultierende Grafik erinnert visuell an einen spitzen Berggipfel mit einer senkrecht abfallenden Flanke.

Das Problem: Wer auf dem Berg sitzt, findet das meistens toll. Bis er es nicht mehr tut.

Entstehung und Verbreitung

Die konzeptionelle Grundlage legte der SEO Glenn Gabe im Januar 2026. Er visualisierte damit das Risiko von „AI Scaling" ohne Qualitätskontrolle.

Malte Landwehr hat den Begriff im deutschsprachigen Raum geprägt und das Phänomen systematisch aufgearbeitet, um vor den langfristigen Konsequenzen rein quantitativ getriebener KI-Strategien zu warnen. Heute steht „Mount AI" in der Branche für das, was passiert, wenn Skalierung die einzige Content-Strategie ist.

Was Mount AI ist und warum es kein Zufall ist

Mount AI entsteht nicht, weil Websites Pech haben. Es entsteht, weil ein klar beschreibbares Playbook angewendet wird: Möglichst viele KI-generierte Artikel in möglichst kurzer Zeit veröffentlichen, auf schnellen Rankingaufstieg setzen, Traffic monetarisieren, und dann entweder das Update abwarten oder bereits auf die nächste Domain wechseln.

In Nischen wie Online-Glücksspiel, Affiliate-Marketing und bestimmten Bereichen des Finanzpublishings ist das ein dokumentiertes, bewusstes Geschäftsmodell. Wer das mit offenen Augen betreibt und die Risiken kennt, trifft eine informierte Entscheidung. Das ist legitim, auch wenn es nicht das ist, was ich meinen Kunden empfehle.

Das eigentliche Problem ist ein anderes.

Tomek Rudzki von Peec AI hat sich die Erfolgsgeschichten und Referenzkunden einiger populärer AI-Content-Tools vorgenommen – also die Seiten, mit denen diese Tools aktiv Werbung machen, die Kunden, die in Interviews und Case Studies als Beleg für die Wirksamkeit des Produkts herhalten. Das Ergebnis: 36 Prozent dieser Vorzeigekunden hatten massive Google-Sichtbarkeitsverluste erlitten. Bei einem der untersuchten Tools lag der Anteil bei 75 Prozent.

Drei von vier Flaggschiff-Kunden. Nicht zufällig ausgewählte Websites, nicht Grenzfälle. Die Kunden, die das Marketing-Material tragen.

Malte Landwehr hat eine eigene Analyse durchgeführt und kommt auf 57 Prozent der untersuchten Case-Study-Kunden mit signifikanten Verlusten. 22 Prozent davon mit dem klassischen Mount-AI-Muster. Der Rest hat die Wachstumsphase übersprungen und ist direkt ins Minus gegangen.

Das sind keine Ausreißer. Das ist die Regel.

Welches Tool ist gemeint? Eine begründete Einschätzung

Malte hat bewusst darauf verzichtet, das Tool beim Namen zu nennen. Er sagt selbst, er halte es nicht für den schlimmsten Täter in diesem Markt. Rudzki ist ebenso vorsichtig. Ich werde beide nicht überbieten, aber ein paar Einordnungen sind möglich.

Der Markt für KI-gestützte SEO-Content-Tools ist in den letzten zwei Jahren explodiert. Die Platzhirsche, die aggressiv mit Case Studies und Sichtbarkeitswachstum werben und gleichzeitig explizit auf Skalierung setzen, sind eine überschaubare Gruppe. Jasper, Copy.ai und Writesonic sind die bekannteren Namen auf der breiteren Seite. Im spezifischen SEO-Content-Segment, also bei Tools, die explizit auf Rankingverbesserung durch generierten Content zielen, sind Surfer AI, Frase, Koala AI und eine ganze Reihe kleinerer Anbieter relevant.

Das Muster, das die Daten beschreiben, passt am stärksten zu Tools, die mit schnellem Skalierungsversprechen vermarktet werden und SEO-spezifische Outputs als Kern ihres Angebots haben. Wer genau gemeint ist, kann jeder selbst recherchieren, indem er die öffentlichen Case-Study-Seiten der größten Anbieter aufruft und schaut, was Ahrefs, Sistrix und Semrush für diese Domains zeigen. Am besten sieht man es in Sistrix.

Das Ergebnis dieser Recherche ist erfahrungsgemäß erhellend.

Googles Reaktion bisher: Nicht besonders subtil

Googles März-2024-Core-Update hat im Verlauf seines Rollouts und den parallel ausgerollten Spam-Maßnahmen 837 Domains vollständig deindexiert. Ian Nuttall, der zu diesem Zeitpunkt knapp 50.000 Websites trackte, hat die Zahlen dokumentiert: über 20 Millionen monatliche Besuche, einfach weg. Eine parallele Untersuchung von Originality AI an einer eigenen Stichprobe von 79.000 Websites ergab, dass bei allen deindexierten Sites Anzeichen von KI-generiertem Content vorlagen, bei der Hälfte davon zu 90 bis 100 Prozent. Das ist kein Beweis für Kausalität, aber es ist auch kein Zufall.

Google hat in den letzten zwei Jahren systematisch signalisiert, dass skalierte, generische Inhalte ohne erkennbaren inhaltlichen Mehrwert nicht mehr toleriert werden. Lily Ray, eine der erfahrensten Analytikerinnen für Core Updates, hat öffentlich eine weitere Verschärfung für 2026 in Aussicht gestellt.

Was die Datenlage dazu sagt: NP Digital hat 744 Artikel über 68 Websites hinweg ausgewertet und kommt zu dem Ergebnis, dass menschlich geschriebener Content über die Zeit 5,44-mal mehr Traffic generiert als rein KI-generierter. Die Ahrefs-Studie mit 600.000 Seiten über 100.000 Keywords findet zwar keinen statistischen Zusammenhang zwischen KI-Content-Anteil und Ranking-Position, stellt aber fest, dass nur 4,6 Prozent der top-rankenden Seiten vollständig KI-generiert sind und diese Seiten praktisch nie Position 1 erreichen.

Das bedeutet nicht, dass KI im Content-Prozess nichts bringt. Es bedeutet, dass Quantität allein seit Jahren nicht funktioniert und sich daran mit KI-Unterstützung nichts geändert hat. Es geht nur schneller. Der Aufstieg und der Absturz.

Wenn du verstehen willst, wie Googles KI-Features das Suchverhalten und die organische Sichtbarkeit gerade konkret verschieben, lohnt sich ein Blick in die Auswertung zu Googles neuen KI-Features und ihren SEO-Auswirkungen.

Der AI-Search-Aspekt, den fast alle übersehen

Wer glaubt, er könne sich nach einem Google-Penalty auf AI-Search als alternativen Traffic-Kanal verlassen, wird enttäuscht. Malte Landwehr hat genau das untersucht, als Grokipedia Anfang 2026 seine Google-Rankings verlor.

ChatGPT, AI Mode und AI Overviews haben ihre Citations für die betroffene Domain zum gleichen Zeitpunkt reduziert. Nicht zeitversetzt, nicht schrittweise. Gleichzeitig.

AI-Chatbots nutzen Suchmaschinen-Signale zur Einordnung und Gewichtung von Quellen. Wenn Google eine Domain abstraft, wird sie auch für Sprachmodelle, die auf Suchmaschinendaten als Grounding-Layer zurückgreifen, weniger relevant. Wie genau dieser Mechanismus im Zusammenhang mit strukturierten Daten und AI-Citation-Signalen funktioniert, ist im Leitfaden zu strukturierten Daten für AI Search ausführlich beschrieben.

Ein Google-Penalty macht dich heute nicht nur in der traditionellen Suche unsichtbar. Er macht dich überall unsichtbar.

Wer darauf hofft, durch aggressive AI-Content-Skalierung kurzfristig Sichtbarkeit aufzubauen und im Ernstfall über ChatGPT und Perplexity sichtbar zu bleiben, wenn Google zuschlägt, hat das Ökosystem falsch verstanden.

n8n, Automatisierungspipelines und das LinkedIn-Like-for-Template-Universum

Die Skalierung von KI-Content war bis vor zwei Jahren noch halbwegs technisch komplex. Wer Tausende von Artikeln generieren wollte, brauchte Entwickler, API-Kenntnisse und zumindest ein rudimentäres Verständnis von Prompting und Output-Kontrolle.

Das hat sich geändert.

n8n, Make und Zapier haben die Content-Pipeline demokratisiert. Auf LinkedIn werden täglich Workflows geteilt, mit denen man angeblich „vollautomatisch 500 SEO-Artikel pro Monat" produzieren kann. Das Angebot ist simpel: Like den Post, kommentiere „Template" und bekomme den Workflow zugeschickt. Gelegentlich kostet das eine E-Mail-Adresse und man landet danach in einem Newsletter-Funnel.

Was diese Workflows tun: Sie verbinden ein Keyword-Tool oder eine Tabelle mit einem LLM-API-Call, formatieren den Output und schieben ihn in ein CMS. Der Mensch in dieser Kette ist optional. Die Kontrolle über Qualität, Faktentreue und inhaltlichen Mehrwert ist es auch.

Das Ergebnis ist vorhersehbar. Tausende von Artikeln, die dieselben Fragen mit denselben Antwortmustern beantworten, die ChatGPT einem sowieso direkt gibt, wenn man fragt. Tomek Rudzki hat für genau das eine einfache Prüffrage formuliert: Würde ich diesen Artikel lesen wollen? Fügt er etwas hinzu, was ChatGPT nicht direkt liefert? Wenn die Antwort nein ist, sollte man nicht veröffentlichen.

Die meisten dieser Pipeline-Outputs bestehen diese Prüfung nicht.

Was mich dabei mehr beschäftigt als die schlechte Content-Qualität selbst: Diese Workflows werden nicht primär an Leute verkauft, die bewusst Affiliate-Sites im Wegwerf-Modus betreiben. Sie werden an Gründer verkauft, die einen Blog für ihr SaaS-Produkt aufbauen wollen. An Handwerksbetriebe, die bei Google gefunden werden möchten. An mittelständische Unternehmen, die ihr Content-Marketing skalieren wollen. Wer sich für den sinnvollen Einsatz von KI-Agenten in Content-Workflows interessiert, findet eine differenziertere Einordnung im Artikel zu Vibe Coding und KI-Agenten.

Die Leute, die diese Templates teilen, wissen oft selbst nicht genau, was sie anrichten. Oder sie wissen es und teilen trotzdem.

Was die Tool-Anbieter schulden, aber nicht liefern

Das eigentliche Versäumnis ist kein technisches, es ist ein kommunikatives.

Kein AI-Content-Tool-Anbieter, der explizit an Marken mit langfristigen Reputationsinteressen verkauft, hat in seinen Marketing-Materialien eine Risikoaufklärung, die dieser Bezeichnung würdig wäre. Ich habe jedenfalls keine gefunden. Die Case Studies zeigen Sichtbarkeitswachstum. Sie zeigen keine Sichtbarkeitskurven über zwei oder drei Jahre. Sie zeigen keine Folgeentwicklung nach Core Updates.

„Rank, bank and tank" als bewusste Strategie mit voller Kenntnis der Risiken ist ein Geschäftsmodell. Nicht für die breite Masse, und ich werde es hier auch nicht empfehlen, aber es hat seine Berechtigung. Die Mechanismen dahinter sind im Artikel zu Black Hat SEO ausführlicher beschrieben.

Dasselbe Playbook als nachhaltige Wachstumsstrategie an Marken mit echter Reputation zu vermarkten, ist etwas anderes. Es ist unehrlich. Und die Daten, die jetzt vorliegen, machen es zunehmend schwer zu behaupten, man habe das nicht gewusst.

Tomek Rudzki formuliert die Mindestanforderung klar: Erklärt euren Kunden, was die Forschung tatsächlich zeigt. Lasst sie eine informierte Entscheidung treffen. Das sollte keine Bitte sein müssen.

Was das für dich konkret bedeutet

Wenn du KI im Content-Prozess nutzt - was ich tue und empfehle - gelten ein paar Regeln, die sich direkt aus den vorliegenden Daten ableiten.

KI ist ein Werkzeug im Schreibprozess, kein Ersatz für Recherche, Positionierung und inhaltliche Substanz. Der Unterschied zwischen einem KI-unterstützten Artikel und einem KI-generierten Artikel ist nicht semantisch, er ist fundamental. Ersteres beginnt mit einer menschlichen These. Letzteres beginnt mit einem Keyword.

Skalierung ohne Qualitätskontrolle ist kein Content-Marketing, es ist Content-Verschmutzung. Wer 200 Artikel pro Monat veröffentlicht, von denen keiner das Niveau hat, das er selbst setzen würde, wenn er die Zeit hätte jeden einzeln zu schreiben, hat ein Problem, das kein Workflow löst.

Wenn du einen n8n-Workflow auf LinkedIn siehst, der dir verspricht, Content-Marketing vollständig zu automatisieren, und der für ein Like zu haben ist, dann ist das kein Insider-Tipp. Das ist Content-Marketing des Workflow-Erstellers. Du bist nicht der Nutznießer, du bist das Produkt.

Die Frage, ob KI-generierter Content von Google erkannt wird, ist inzwischen die falsche Frage. Die richtige Frage ist, ob er für den Leser besser ist als das, was er anderswo bekommt. Wenn nicht, wird Google das über kurz oder lang ebenfalls feststellen. Die Systeme werden nicht schlechter.

Eine abschließende Beobachtung

Der Markt für AI-Content-Tools hat in den letzten zwei Jahren mehr Geld aufgenommen und mehr Versprechen gemacht als die klassische SEO-Branche in einem Jahrzehnt. Evertune hat laut öffentlichen Meldungen 19 Millionen Dollar Funding von Kleiner Perkins erhalten (Stand: Feb 2026, nicht eigenständig verifiziert). Profound 20 Millionen (ebenso). Jasper hat zwischenzeitlich eine Bewertung von rund 1,5 Milliarden Dollar erreicht, die seitdem deutlich korrigiert wurde.

Das Geld fließt in Werkzeuge, die Content schneller und billiger machen. Es fließt nicht in Forschung darüber, ob dieser Content langfristig für die Kunden funktioniert.

Die Antwort auf diese Frage kennen wir inzwischen. Die Daten sind da. Was jetzt fehlt, ist die Ehrlichkeit, sie in die Verkaufsgespräche zu holen.

FAQ

-

Was ist Mount AI genau?

Mount AI bezeichnet eine spezifische, nicht nachhaltige Sichtbarkeitskurve, die entsteht, wenn Websites durch massenhaften Einsatz von KI-generierten Inhalten kurzfristig stark in den Rankings steigen und nach einem Google Core oder Spam Update ebenso steil wieder abstürzen. In Sistrix und ähnlichen Tools ergibt das die charakteristische Bergform mit senkrecht abfallender Flanke.

-

Wie erkenne ich das Mount-AI-Muster bei einer Domain?

Ruf die Domain in Sistrix auf und schau dir den Sichtbarkeitsindex über zwei bis drei Jahre an. Wenn du einen steilen, schnellen Anstieg siehst, dem ein ebenso steiler Absturz folgt, der zeitlich mit einem Google-Update zusammenfällt, ist das das klassische Muster. Kontrolliere zusätzlich, wann die Domain den größten Teil ihres Contents veröffentlicht hat und ob dieser Content thematisch breit gestreut oder inhaltlich dünn ist.

-

Kann ich nach einem Google-Penalty noch über ChatGPT oder Perplexity Sichtbarkeit aufbauen?

Nein. Malte Landwehrs Analyse von Grokipedia zeigt, dass ChatGPT, AI Mode und AI Overviews ihre Citations für die betroffene Domain zum gleichen Zeitpunkt wie Google reduzierten, nicht zeitversetzt. LLMs nutzen Suchmaschinen-Signale als Grounding-Layer. Ein Google-Penalty macht eine Domain heute in der traditionellen Suche und in AI-Search gleichzeitig unsichtbar.

-

Was unterscheidet KI-unterstützten Content von KI-generiertem Content?

KI-unterstützter Content beginnt mit einer menschlichen These, Recherche und Positionierung. KI hilft beim Schreiben, Strukturieren und Überarbeiten. KI-generierter Content beginnt mit einem Keyword und einem Prompt. Der Unterschied ist nicht technischer Natur, er ist inhaltlicher Natur: Das eine hat eine Perspektive, das andere wiederholt, was im Netz bereits steht.

-

Sind alle AI-Content-Tools vom Mount-AI-Phänomen betroffen?

Nicht alle, aber die Datenlage von Rudzki und Landwehr betrifft explizit Tools, die mit schnellem Skalierungsversprechen und SEO-spezifischen Outputs werben. Tools, die KI in einen kontrollierten Redaktionsprozess einbetten, statt ihn zu ersetzen, fallen in eine andere Kategorie.

-

Wie viele Vorzeigekunden der untersuchten AI-Content-Tools hatten Sichtbarkeitsverluste?

Tomek Rudzki kommt auf 36 Prozent im Schnitt, bei einem der untersuchten Tools auf 75 Prozent. Malte Landwehrs eigene Analyse ergibt 57 Prozent der Case-Study-Kunden mit signifikanten Verlusten, davon 22 Prozent mit dem klassischen Mount-AI-Muster.

Quellen: Glenn Gabe auf X, Tomek Rudzki, „The real risk of AI-generated content" (Peec AI, Feb 2026), Malte Landwehr via X (Feb 2026), J. Bobbink via X (Feb 2026), NP Digital AI vs. Human Study (744 Artikel, 68 Sites, 2024), Ahrefs, Si Quan Ong & Xibeijia Guan: 600K Page Analysis (Jul 2025), 837 deindexierte Domains: Ian Nuttall via Search Engine Journal (März 2024), AI-Content-Anteil bei betroffenen Sites: Originality AI (2024)

Könnte dich auch interessieren

-

Wenn ChatGPT dir erklärt, wie man ChatGPT benutzt

- Geschrieben von Carsten Feller

- Veröffentlicht am

-

Von ChatGPT empfohlen werden: Was hinter AI Visibility wirklich steckt

- Geschrieben von Carsten Feller

- Veröffentlicht am

-

Optimales Prompting für o1 & o3: SEO-Guide für Reasoning-Modelle

- Geschrieben von Carsten Feller

- Veröffentlicht am

-

KI im Suchmaschinenmarkt: ChatGPT auf dem Vormarsch

- Geschrieben von Carsten Feller

- Veröffentlicht am

-

Google Web Guide: Wie Googles KI die Suchergebnisse neu sortiert

- Geschrieben von Carsten Feller

- Veröffentlicht am